Actualmente, la inteligencia artificial (IA) y especialmente el ChatGPT, una nueva forma de encontrar información que está causando una auténtica revolución en la sociedad actual a nivel usuario. Personas de todo el mundo usan ya este chat como buscador y como fuente. Por tanto su incorporación al mundo de la medicina era solo cuestión de tiempo.

Pero, ¿qué es ChatGPT? Pues bien, se trata de una tecnología que salió hace 5 meses al mercad. El nombre viene de chatbot, un programa informático que entiende el lenguaje natural y responde de manera coherente a las preguntas de las personas, y GPT es el acrónimo de Generative Pre-trained Transformer. El sistema Chat GPT fue creado por OpenAI, con sede en San Francisco, y no funciona como un motor de búsqueda tipo Google. Ni siquiera está conectado a internet. Toda la información de la que dispone el chatbot está alojada en servidores y en la nube. Una IA que ha sido diseñada para mantener conversaciones con cualquier persona. Sus algoritmos entienden lo que preguntas, incluyendo adjetivos y variaciones que añadas en tus frases, y puede responderte de una manera coherente. ChatGPT utiliza lenguaje natural, y puedes acceder actualmente de forma gratuita. .

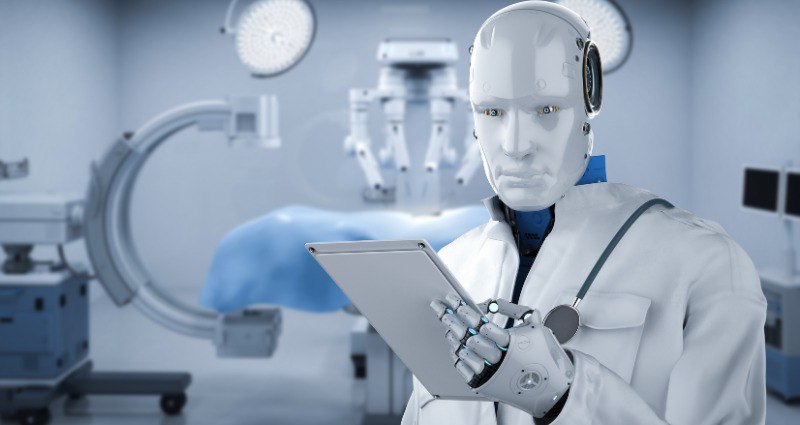

En concreto, en medicina, con la combinación de algoritmos sofisticados y grandes volúmenes de datos médicos, esta tecnología está transformando la forma en que se diagnostican enfermedades, se brinda atención médica y se gestionan los sistemas de salud en todo el mundo.Pero, no podemos olvidar que dicha tecnología no está exenta de riesgos. Por ejemplo, los pacientes también tienen acceso a toda la información que proporciona desde su casa lo que puede llegar a autodiagnósticos sin evidencia científica.

Por tanto, ante tal contexto, la Organización Mundial de la Salud (OMS) ha hecho recientemente, un llamamiento para usar la tecnología con cautela, ya que existe la posibilidad de que cause “daño a los pacientes”. “Si bien la OMS está entusiasmada sobre el uso apropiado de estas tecnologías para apoyar a los profesionales sanitarios, pacientes, investigadores y científicos, nos preocupa que la habitual cautela que se aplica normalmente cuando hay una innovación tecnológica no se esté ejerciendo consistentemente con los modelos de lenguaje”, afirmó la organización a través de un comunicado oficial.

Además, según explica el documento, una adopción precipitada de sistemas poco probados puede llevar a errores por parte de los profesionales sanitarios, causar daño a los pacientes si se usan de forma directa a modo de sustitución de una atención reglada y terminar por echar a perder los beneficios de usar estas tecnologías para la salud de las personas. Hay que ser conscientes de que la tecnología también falla, “los datos que se emplean para entrenar a la inteligencia artificial pueden estar viciados, dando lugar a informaciones engañosas o inexactas que representen un riesgo para la salud, la igualdad y la inclusividad de los pacientes” asegura la OMS.

La IA y, en concreto, el ChatGPT, es capaz de generar respuestas que tienen apariencia plausible y legítima a ojos de un usuario final. Sin embargo, la realidad es que estas pueden ser completamente incorrectas o contener errores serios, “especialmente, en el ámbito de la salud”. Por no mencionar, el riesgo de que estos modelos de lenguaje avanzados puedan usarse para generar información falsa “altamente convincente” que posteriormente pueda distribuirse de forma masiva, ya sea en formato escrito o audiovisual, “haciendo que sea difícilmente distinguible de información fiable”.

Motivos por los que la OMS, sin negar sus beneficios, insta a los Gobiernos a gestionar el uso del ChatGPT asegurando, en todo momento, la seguridad de los pacientes y su protección “a medida que las empresas incrementen sus esfuerzos para comercializar más modelos de lenguaje basados en inteligencia artificial”. Y es que, aunque estudios recientes han asegurado que el uso del Chat GPT mejoró la satisfacción del paciente en un 94%, también se debe tener en cuenta que esta tecnología no debe reemplazar por completo a la atención de un profesional.

Su uso por parte de las compañías

Ahora bien, la realidad es que esta tecnología está arrasando entre la sociedad y ya está siendo empleada por algunos de denomiados gigantes del sector de la salud. Si citamos algunos ejemplos: La multinacional alemana Bayer la emplea para la búsqueda de nuevos fármacos, al igual que sucede con Pfizer o Roche. Su capacidad de analítica de datos permite predecir el comportamiento de moléculas y el posible efecto que tendrían distintos compuestos químicos, una valiosa función que permite ahorrar tiempo y dinero, así como riesgos, según explican las compañías que la emplean.

Asimismo y de forma paralela han surgido empresas que ofrecen servicios de chat online con robots que hacen las veces de doctor. Al buscar en Google una de ellas, el primer resultado que aparece es Dr. Gupta. Y , ¿cómo funciona? Pues bien, al exponer un hipotético dolor al chat, recomienda una serie de remedios caseros, tomar ibuprofeno o paracetamol, además de sugerir aplicar frío en la zona, descanso o masajes y en último término, ya sí, aconseja acudir a un médico si el dolor es persistente.

En definitiva, hay que ser conscientes de que la inteligencia artificial puede ayudar, pero también falla. En especial, cuando el tema es complejo, las fuentes de datos abundan (y en algunos casos son cuestionables), por lo que las respuestas serán menos fiables y es más probable que estén sesgadas. Es decir, cuanto más complicado es el tema, más probable es que ChatGPT “alucine”. Siendo este el término que se utiliza para describir la tendencia documentada del chatbot a “inventarse cosas”.

Seguiremos informando…